اینتل دیروز نسل بعدی واحد پردازش هوش مصنوعی Movidius Vision را با نام Keem Bay معرفی کرد و وعده داد درمقایسهبا رقبا حداکثر ۶ برابر قدرت بیشتری ارائه دهد. در اجلاس AI در سانفرانسیسکو، این شرکت پردازنده جدید شبکه عصبی Nervana را با عنوان NNP-T بهنمایش گذاشت.

اینتل با توسعهی سختافزاری خود درزمینهی هوش مصنوعی و نرمافزارهای جدیدی که ارائه کرده، قصد دارد فرصتهای جدیدی در فضای ابری یا مرکز دادهای برای هوش مصنوعی ایجاد کند. اینتل در این رویداد هوش مصنوعی گفت:

هوش مصنوعی درحالحاضر ۳/۵ میلیارد دلار درآمد سالانه برای اینتل، Naveen Rao ،VP و GM از گروه محصولات AI اینتل بهارمغان آورده است.

مقالههای مرتبط:

- انویدیا Jetson Xavier NX قدرت پردازشی هوش مصنوعی را به دستگاههای رایانش مرزی عرضه میکند

- اینتل: پردازنده ۵۶ هستهای زئون، نسخه ۶۴ هستهای اپیک AMD را شکست میدهد

همانطورکه مشخص شده، اکنون هر کسبوکار از اینترنت استفاده میکند که در آیندهای نزدیک برای هوش مصنوعی نیز چنین اتفاقی خواهد افتاد و هر شرکت تکنولوژیمحوری به هوش مصنوعی نیاز پیدا خواهد کرد. همچنین، سختافزار و بخش محاسباتی به نقطهی شکست رسیده است و به سختافزارهای تخصصیتری نیاز داریم. اینتل اولین VPU Movidius را در سال ۲۰۱۷ ارائه کرد و Keem Bay با ارائه در نیمهی اول سال ۲۰۲۰، ویژگیهای منحصربهفردی از معماری را برای بهبود کارایی و توانمندی بهارمغان خواهد آورد.

اینتل میگوید نسل بعدی VPU تقریبا ۱۰ برابر عملکرد استنتاجی قویتری درمقایسهبا نسل اول ارائه میدهد. طبق آزمایشها اولیه، Keem Bay بیش از چهاربرابر توان عملیاتی TX2 SOC Nvidia با یکسوم مصرف انرژی ارائه خواهد داد. همچنین، میتواند تقریبا همان توان عملیاتی Xavier SOC Nvidia را با یکپنجم مصرف انرژی ارائه دهد.

VPU برای رایانش لبهای و دید کامپیوتری و برنامههای استنتاجی طراحی شده و ابعاد آن فقط ۷۲ میلیمتر است که این ابعاد بسیار کوچک و ظریف است. این VPU اینتل مناسب برای انواع مختلفی از فرمها و روباتیک و کارتهای قدرتمند PCIe است. درنهایت، تراشهی Movidius در اوایل سال ۲۰۲۰ به بازار عرضه خواهد شد.

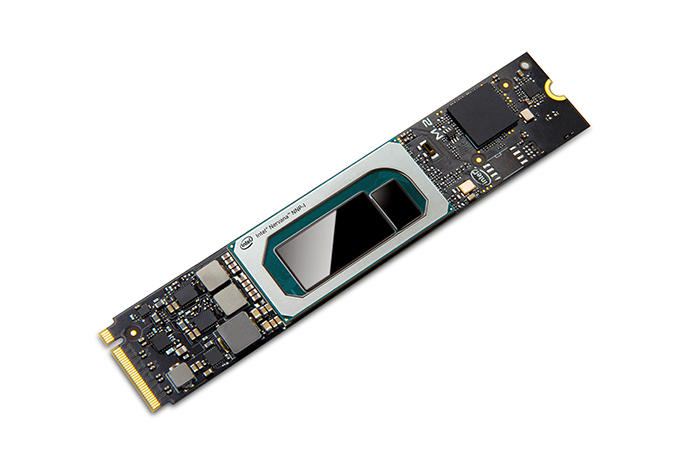

NNP-T1000 اینتل برای آموزش و NNP-I1000 اینتل با توانایی پردازش محاسبات استنتاجی اولین ASICهای هدفمند بهمنظور ایجاد یادگیری عمیق پیچیده برای مشتریان ابری و مراکز دادهای هستند. بهگفتهی اینتل، NNP-T برای آموزش برنامههای یادگیری عمیق در دنیای واقعی طراحی شده است و از بهرهوری چشمگیری برخوردار خواهد بود. NNP-I نیز، برای اجرای عملیات استنتاجی در زمان واقعی با حجم زیاد و تأخیر کم طراحی شده است. OpenVINO که ابزاری برای طراحی آسان و استنباط یادگیری عمیق در برنامه است، از NNP-I پشتیبانی خواهد کرد. درکنار OpenVINO، اینتل دیروز با معرفی Intel DevCloud جدید، این امکان را دراختیار توسعهدهندگان قرار داد تا قبل از خرید سختافزار، راهحلهای هوش مصنوعی را در طیف گستردهای از پردازندههای اینتل نمونهسازی و آزمایش کنند. درحالحاضر، بیش از ۲،۷۰۰ مشتری اینتل از DevCloud استفاده میکند.

نظر شما